Устаревшие API часто не справляются с современными требованиями, что приводит к медленному времени ответа, расстроенным пользователям и увеличению затрат. Хорошая новость? Вам не нужна полная переделка, чтобы улучшить производительность. Вот как вы можете решить наиболее распространённые проблемы:

Для команд, ищущих модернизацию без значительных ресурсов для кодирования, такие платформы как Adalo, конструктор приложений без кода для веб-приложений на основе базы данных и нативных приложений iOS и Android — одна версия для всех трёх платформ, опубликованная в Apple App Store и Google Play, предоставляют практическую альтернативу. Эти инструменты позволяют вам создавать современные приложения, подключённые к API, при этом постепенно отказываясь от устаревших систем.

- Устаревшая архитектура: Монолитные системы и более старые протоколы, такие как HTTP/1.1, создают узкие места. Переключение на микросервисы или обновление на HTTP/2/3 может улучшить эффективность.

- Неэффективное извлечение данных: Неиндексированные запросы, избыточные вызовы и проблемы N+1 замедляют работу. Оптимизация запросов, добавление индексов и использование пула соединений могут ускорить операции.

- Отсутствие кеширования: Без кеширования API многократно обрабатывает одни и те же запросы. Внедрение граничного, прикладного и клиентского кеширования может сократить время ответа на 90%.

Быстрые улучшения:

- Добавьте слои кеширования (например, Redis, Cloudflare).

- Оптимизируйте запросы к базе данных (например, индексирование, разбивка на страницы).

- Используйте обёртки API для современной функциональности без перестройки.

Долгосрочные решения:

- Постепенно переходите на микросервисы, используя методы, такие как Strangler Fig Pattern.

- Мониторьте производительность с помощью инструментов, таких как Prometheus или Datadog.

- Внедрите ИИ для анализа в реальном времени и предсказательного масштабирования.

Даже незначительные улучшения — такие как кеширование или оптимизация запросов — могут значительно снизить задержку и улучшить пользовательский опыт. Начните с малого, измеряйте воздействие и переходите к более современной и эффективной системе.

Топ 7 способов повысить производительность вашего API в 10 раз

Распространённые проблемы производительности в устаревших API

Чтобы решить проблемы производительности в устаревших API, вам сначала нужно определить, что вызывает замедление. Большинство проблем подпадают под три категории: устаревшие конструкции систем, неэффективное извлечение данных и отсутствие механизмов кеширования. Рассмотрим каждую из них.

Старая архитектура и протоколы

Устаревшие API часто полагаются на монолитные архитектуры, где все функции плотно объединены в одно приложение. Такая структура делает масштабирование неэффективным — если одному компоненту требуется больше ресурсов, вся система должна масштабироваться, что увеличивает узкие места в трафике и централизует нагрузку на систему.

Протоколы, используемые старыми системами, усугубляют неэффективность. API, построенные на SOAP или ранних версиях REST , часто страдают от избыточной выборки, возвращая большие ненужные объекты данных, которые впустую расходуют пропускную способность. Эти системы часто не имеют постоянных соединений, требуя свежей попытки подключения TCP (и SSL/TLS) для каждого запроса. Многие по-прежнему используют HTTP/1.1, который обрабатывает запросы последовательно и не поддерживает мультиплексирование, как HTTP/2 или HTTP/3. Эта синхронная модель ещё больше замедляет операции.

Реальный пример? Netflixпереход с монолитной структуры на микросервисы с периферийными вычислениями привёл к 70% улучшению производительности API. Это подчёркивает, как модернизация архитектуры может существенно повлиять на время ответа и пользовательский опыт.

Неправильные методы извлечения данных

То, как устаревшие API обрабатывают извлечение данных, — это ещё одно распространённое узкое место. Неиндексированные запросы к базе данных вынуждают систему сканировать целые таблицы, что значительно замедляет обработку. Хуже того, неправильные методы кодирования, такие как проблема N+1— где вместо выборки связанных данных в одном запросе выполняется несколько вызовов базы данных — добавляют ненужные задержки. Это особенно проблематично для мобильных пользователей с более медленными соединениями.

Другие неэффективности включают избыточные вызовы данных, когда одна и та же информация запрашивается несколько раз во время одной транзакции, или использование вложенных циклов, которые усиливают задержки по мере масштабирования данных. Системы, которые часто открывают и закрывают соединения с базой данных вместо использования пула соединений, также испытывают более высокую задержку. Инструменты мониторинга, такие как Time to First Byte (TTFB) или команда SQL EXPLAIN могут помочь выявить узкие места, такие как отсутствующие индексы.

Отсутствие систем кеширования

Отсутствие кэширования — еще один фактор, снижающий производительность. Без кэширования устаревшие API повторно генерируют одинаковые ответы и выполняют идентичные запросы к базе данных для каждого запроса. Это не только увеличивает задержку, но и оказывает постоянное давление на серверные системы, особенно во время всплесков трафика.

Отсутствие кэширования на граничных узлах добавляет дополнительные задержки, так как данные должны передаваться с центрального сервера пользователю при каждом запросе. Устаревшие системы также сильно полагаются на опрос вместо событийно-ориентированных паттернов, что крайне неэффективно — новые данные извлекаются только в 1,5% случаев при опросе.

Внедрение кэширования, хотя и сложное в старых системах, может значительно улучшить производительность. Однако для этого требуется хорошо продуманная логика инвалидации, такая как очистка, инициируемая событиями, или точные значения времени жизни, чтобы данные оставались актуальными. При правильной реализации кэширование может снизить время ответа API на 70–90% для кэшированных ответов, что делает его одним из наиболее эффективных способов модернизации производительности.

Как улучшить производительность устаревших API

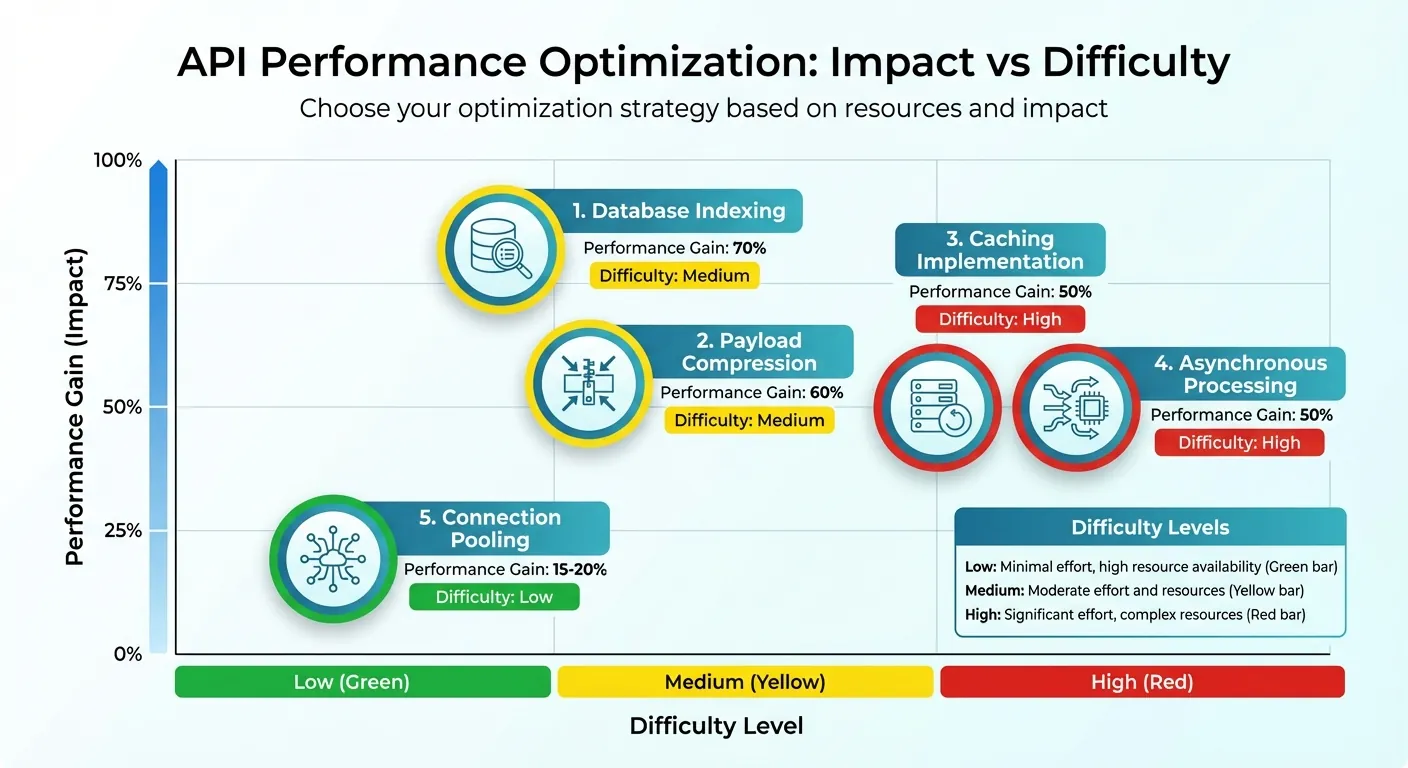

Методы оптимизации производительности API: сравнение воздействия и сложности

Повышение производительности устаревших API часто сводится к умным стратегиям, таким как добавление слоев кэширования, оптимизация запросов к базе данных и использование оболочек API. Вот более подробный взгляд на то, как эти методы могут иметь значение.

Добавление слоев кэширования

Кэширование — это настоящий прорыв, когда речь идет об ускорении ответов API. Сохраняя часто используемые данные временно, вы можете избежать повторяющихся обращений к базе данных или переполнения выходных данных. многоуровневая стратегия кэширования работает лучше всего, охватывая разные части системы.

- Кэширование на граничных узлах: такие сервисы, как Cloudflare или Akamai , хранят данные ближе к пользователям, резко сокращая время ожидания — со сотен миллисекунд до нескольких.

- Кэширование на уровне приложения: инструменты, такие как Redis или Memcached , обрабатывают кэширование на стороне сервера для тяжелых запросов к базе данных или вычисленных данных.

- Кэширование на стороне клиента: это хранит неизменяемые данные непосредственно на устройстве пользователя или в браузере.

Вы также можете реализовать кэширование на уровне шлюза API, чтобы обеспечить согласованность политик между конечными точками. Для эффективного кэширования сосредоточьтесь на трех ключевых факторах:

- Время жизни (TTL): установите подходящие длительности в зависимости от того, как часто меняются данные.

- Ключи кэша: используйте заголовки или параметры URL для уникальной идентификации запросов.

- Стратегии инвалидации: обновляйте устаревшие кэшированные данные в часы минимальной нагрузки.

«Если существует супергерой по снижению задержек, то это определенно кэширование. Ничто не сравнится с тем, чтобы полностью избежать запроса!» - Zuplo

Результаты говорят сами за себя. Например, Xata снизила задержку API на 50%, комбинируя edge computing и кэширование через CDN Cloudflare. Чтобы максимизировать преимущества, отслеживайте трафик на предмет повторяющихся запросов и настраивайте параметры TTL, чтобы сбалансировать свежесть и скорость.

Исправление запросов к базе данных

Часто медленные запросы к базе данных являются основной причиной медленных API. Оптимизация этих запросов может значительно улучшить время ответа с минимальными изменениями инфраструктуры.

- Индексирование: применяйте индексы к часто запрашиваемым столбцам, особенно к тем, которые используются в предложениях WHERE, JOINs или ORDER BY. Это может сократить время выполнения запроса на 90%.

- Избирательное получение данных: избегайте использования

SELECT *. Вместо этого извлекайте только нужные вам столбцы, сокращая обработку и сетевую нагрузку. - Переписывание запросов: упростите запросы, заменив подзапросы на JOINs или временные таблицы. Используйте

EXISTSвместоINдля лучшей производительности при условных проверках и фильтруйте данные с помощьюWHEREпредложений, а неHAVING, так как первое обрабатывается раньше. - Пулинг соединений: предустановленные подключения к базе данных экономят время, устраняя расходы на открытие и закрытие подключений для каждого запроса. Это может повысить производительность системы на 15–20%.

- Постраничная навигация: разбивайте большие наборы данных на меньшие части с помощью

LIMITиOFFSETили методов на основе курсоров. Установите размеры страниц по умолчанию (10–50 элементов) и ограничения, чтобы предотвратить перегрузку системы от больших запросов.

| Методика оптимизации | Потенциальный прирост производительности | Уровень сложности |

|---|---|---|

| Индексирование базы данных | 70% | Среднее |

| Сжатие полезной нагрузки | 60% | Среднее |

| Внедрение кеширования | 50% | Высокая |

| Асинхронная обработка | 50% | Высокая |

| Пул соединений | 15–20% | Низкий |

Использование API-оберток

API-обертки предлагают практический способ модернизации устаревших систем без полного переделывания. Действуя в качестве трансляционного слоя, они обеспечивают беспрепятственное взаимодействие старых систем с более новыми сервисами. Обертки централизуют такие задачи, как безопасность, маршрутизация и аналитика, оптимизируя операции.

Обертки также оптимизируют производительность, обрабатывая аутентификацию, ограничение частоты запросов и трансляцию протоколов. Они могут уменьшить полезную нагрузку, удаляя ненужные поля или преобразуя данные в более эффективные форматы, что приводит к более быстрой обработке.

«Промежуточное программное обеспечение снижает сложность, переводя сигналы между старыми и новыми системами, улучшая взаимодействие без необходимости полной переделки системы». — Центр обучения Zuplo

Для систем с рассредоточенными источниками данных GraphQL может служить оберткой, позволяя клиентам запрашивать только необходимые им данные в одном запросе. Развертывание оберток на границе сети дополнительно снижает задержку, выполняя операции, такие как аутентификация, ближе к пользователям.

Практические примеры подчеркивают ценность оберток. Команда, столкнувшаяся с мобильным API, застрявшим на 40 транзакциях в секунду, внедрила многоуровневые API с параллельной обработкой, кешированием, разбиением на страницы и объединением соединений. Эти изменения подняли систему до 100 TPS. Обертки упрощают интеграцию устаревших систем, подготавливая их к будущим требованиям.

Пошаговая модернизация устаревших API

Постепенное обновление устаревших API может значительно снизить риски миграции. Этот подход особенно важен, если учесть, что 83% миграций данных заканчиваются неудачей или превышают бюджет. Постепенное обновление систем позволяет сохранять существующий функционал при внедрении новых компонентов, отвечающих современным требованиям.

Переход на архитектуру микросервисов

Разделение монолитного API на микросервисы дает вам больше контроля без полной переделки. Практический способ достичь этого — применить Паттерн Strangler Fig. Это включает размещение шлюза API — такого как Kong или AWS API Gateway — между вашими клиентами и устаревшей системой. Оттуда вы можете медленно заменять конкретные функции микросервисами. Начните с низкорисковых компонентов, направьте минимальный трафик и расширяйте по мере того, как производительность будет соответствовать ожиданиям.

Shopify успешно использовала этот метод в 2021 году при рефакторинге своей модели «Shop», массивного «Божественного объекта» из 3000 строк. Им удалось сохранить работоспособность сервисов для более чем 1 миллиона продавцов, при этом улучшив время выполнения CI-конвейера на 60% — с 45 минут до 18 минут — и сократив время развертывания примерно до 15 минут.

Организации, принявшие эту стратегию, часто сообщают об экономии затрат в размере 20–35% после миграции. Чтобы обеспечить согласованность во время переходного периода, вы можете реализовать одновременную запись данных в старую и новую базы данных. Кроме того, автоматические выключатели могут защитить систему, временно отключая конечные точки при возникновении ошибок, предотвращая масштабные сбои.

Использование искусственного интеллекта для мониторинга производительности

Инструменты на основе искусственного интеллекта предоставляют упреждающий способ мониторинга производительности путем анализа паттернов трафика и обнаружения аномалий в режиме реального времени. Они могут отслеживать проблемы с задержкой, предлагать исправления и даже предсказывать спрос для лучшего распределения ресурсов. Предиктивное масштабирование гарантирует готовность ресурсов при необходимости, а умная маршрутизация трафика направляет пользователей на самые быстрые конечные точки во время процесса миграции.

Для тестирования искусственный интеллект может автоматически обновлять неработающие тестовые скрипты при изменении программного обеспечения, сокращая время ручного обслуживания на целых 70%. Инструменты, такие как StormForge анализируют данные приложения для рекомендации оптимального распределения ресурсов, что может помочь снизить затраты на облачные вычисления без ущерба для производительности.

Подключение к современным платформам

Модернизация устаревших систем не всегда означает начинать с нуля. Инструменты, такие как DreamFactory могут генерировать REST API из существующих баз данных примерно за 5 минут, преобразуя устаревшие SOAP-системы в JSON REST-интерфейсы. Эта возможность, в сочетании с микросервисами и AI-аналитикой, расширяет функциональность устаревших API.

Ada, конструктор искусственного интеллекта Adalo, позволяет вам описать то, что вы хотите, и генерирует ваше приложение. Magic Start создает полные основы приложения из описания, а Magic Add добавляет функции на естественном языке.

После того как эти API начнут работать, приложения на основе искусственного интеллекта, такие как Adalo могут подключаться к ним для создания современных мобильных и веб-приложений. Функция External Collections Adalo делает возможным извлечение данных как из микросервисов, так и из устаревших баз данных, что позволяет создавать готовые к производству приложения за дни вместо месяцев. Конструктор приложений платформы с Magic Start генерирует полные основы приложений из текстовых описаний — опишите то, что вы хотите создать, и он автоматически создаст структуру вашей базы данных, экраны и потоки пользователя.

Для команд, озабоченных масштабируемостью, модульная инфраструктура Adalo поддерживает приложения с более чем 1 миллионом активных пользователей в месяц, обрабатывая более 20 миллионов ежедневных запросов с доступностью 99%+. В отличие от оберток приложений, которые сталкиваются с ограничениями скорости при высокой нагрузке, эта специально разработанная архитектура сохраняет производительность при масштабировании. При цене $36/месяц без ограничений на действия, пользователей, записей или хранилище, она предлагает предсказуемое ценообразование без платежей на основе использования, которые делают другие платформы непредсказуемыми.

Jochen Schweizer mydays Group применила постепенный подход к модернизации после слияния. Они поддерживали 100%-ную доступность во время переходного периода, снизили время загрузки страницы на 37% и значительно повысили коэффициент конверсии. Их усилия получили награду «Клиент года» на Pimcore Inspire 2021.

Тестирование и мониторинг производительности с течением времени

Модернизация устаревших API — это не одноразовая задача. Она требует постоянного тестирования и мониторинга для поддержания производительности. Цель? Выявить и устранить проблемы до того, как они повлияют на пользователей. Управление производительностью — это постоянный процесс.

Тестирование под нагрузкой и стресс-тестирование

Различные методы тестирования помогают выявить конкретные слабые места API. Вот как они работают:

- Базовое тестирование: имитирует обычный трафик для определения эталонов производительности.

- Тестирование скачков: имитирует внезапные всплески трафика, такие как вирусная маркетинговая кампания, чтобы увидеть, насколько хорошо ваш API справляется с неожиданными нагрузками.

- Тестирование стресса: нагружает ваш API сверх его пределов, чтобы выявить точку отказа. Это показывает, корректно ли ваша система терпит отказ с помощью ограничения частоты запросов или полностью падает.

- Тестирование выносливости: применяет умеренную нагрузку в течение длительных периодов, чтобы выявить утечки ресурсов, такие как незакрытые подключения к базам данных или проблемы с памятью, которые проявляются только с течением времени.

«Тестирование производительности API — это всё о снижении риска отказа. Объем усилий, которые вы вкладываете в тестирование вашего API, должен быть пропорционален влиянию его отказа на ваш бизнес». — Loadster

Обратите внимание на паттерны «хоккейной клюшки» в результатах тестов — когда пропускная способность внезапно выходит на плато, а время отклика и ошибки резко возрастают. Инструменты, такие как Protocol Bots от Loadster, могут автоматизировать запросы на уровне HTTP, избавляя от накладных расходов браузера, тогда как EchoAPI разбивает запросы на подробные этапы жизненного цикла (например, поиск в DNS, установление соединения SSL/TLS, время до первого байта). Эти данные помогают точно определить, где возникают задержки. Для более реалистичных результатов варьируйте полезные нагрузки тестирования с различными входными данными вместо того, чтобы многократно обращаться к одному и тому же кешированному ответу.

Эти тесты закладывают основу для непрерывного мониторинга.

Мониторинг производительности в реальном времени

Хотя тестирование имитирует потенциальные проблемы, мониторинг в реальном времени выявляет проблемы по мере их возникновения. Инструменты, такие как Prometheus, New Relic, Dynatraceи Datadog, предлагают распределённую трассировку, которая отслеживает запросы между сервисами, обеспечивая вам глубокую видимость вашей системы. Даже небольшая задержка — например 100 миллисекунд — может снизить коэффициент конверсии на 7%.

Сосредоточьтесь на времени отклика p95 и p99 (95-м и 99-м процентилях) вместо среднего значения. Эти метрики показывают, как пользователи взаимодействуют с вашим API при высоком трафике или граничных случаях, а не только в идеальных условиях. Установите информационные панели с оповещениями об отклонениях, например когда время отклика p95 превышает 200 миллисекунд. Не забывайте мониторить сторонние сервисы. Их проблемы могут повлиять на производительность вашего приложения, даже если ваши внутренние системы работают нормально.

Непрерывная оптимизация

Тестирование и мониторинг — это только начало — постоянная оптимизация гарантирует, что ваш API будет постоянно улучшаться. Например, Xata снизила задержку API на 50% благодаря использованию CDN Cloudflare и пограничных вычислений для обработки запросов ближе к пользователям. Аналогично, Netflix улучшила производительность API на 70% путём развёртывания микросервисов на периферии, сокращая расстояние, которое данным нужно преодолеть между клиентами и серверами.

Интегрируйте тесты производительности в конвейеры CI/CD (например, Jenkins, GitLab, CircleCI), чтобы проверять производительность без замедления развёртываний. Используйте автоматические выключатели для временного отключения проблемных эндпоинтов и предотвращения каскадных сбоев. Наконец, свяжите технические улучшения с бизнес-метриками — покажите, как снижение задержки повышает коэффициент конверсии или сохранение клиентов. Это поддерживает заинтересованность заинтересованных лиц в улучшении производительности.

Для команд, создающих новые фронт-енды на основе оптимизированных API, современные конструкторы приложений могут значительно ускорить разработку. Функция Magic Add от Adalo позволяет вам добавлять экраны и функциональность, описав желаемое на простом языке, а X-Ray выделяет проблемы производительности до того, как они повлияют на пользователей. Этот подход с помощью ИИ означает, что вы можете быстро итерировать по мере улучшения производительности вашего API, без ожидания традиционных циклов разработки.

Заключение

Производительность устаревшего API — это больше, чем технический вопрос — это критический приоритет для бизнеса. Как точно заявляет Nordic APIs:

«Производительность API — это всё. Это то единственное, что отделяет успех вашего API от того, что пользователи откажутся от вашего API в пользу чего-то более надёжного и эффективного».

Когда API работают медленно, пользователи уходят. Даже небольшие задержки могут привести к резкому падению коэффициента конверсии, а разработчики теряют драгоценное время на поиск ошибок вместо создания новых функций.

Хорошая новость? Вам не нужна полная переработка, чтобы увидеть результаты. Комбинация быстрых побед и стратегических улучшений может справиться с задачей. Начните с простых исправлений, таких как кеширование, которое может сократить время отклика на 70–90%, или сжатие, которое уменьшает размер полезных данных на 60–80%. Эти изменения не только обеспечивают немедленные улучшения, но и закладывают основу для более крупных инициатив, таких как переход на микросервисы.

Рассматривайте оптимизацию как пошаговый процесс, а не одноразовое усилие. Начните с измерения текущей производительности, затем сосредоточьтесь на значительных изменениях в течение первых 30 дней. Решите конкретные узкие места в течение следующих трёх месяцев и спланируйте более серьёзные архитектурные обновления в течение шести месяцев или более. Этот метод минимизирует риски, обеспечивая стабильность системы на протяжении всего перехода.

Стоимость игнорирования производительности выходит далеко за рамки медленных API. Потеря доходов от заброшенных корзин, возрастающие затраты на инфраструктуру и ущерб репутации вашего бренда создают убедительный аргумент в пользу активной оптимизации. Инвестиции в улучшение производительности окупаются в долгосрочной перспективе.

Чтобы оставаться впереди, сделайте оптимизацию постоянным усилием. Интегрируйте тесты в ваши конвейеры CI/CD и отслеживайте метрики, такие как время отклика p95 и p99. Согласуйте технические улучшения с ключевыми бизнес-целями, такими как повышение коэффициента конверсии и сохранение клиентов. Этот подход гарантирует, что ваши API не только соответствуют потребностям вашего бизнеса, но и обеспечивают устойчивый рост.

Похожие посты в блоге

- 5 советов по снижению задержки запроса базы данных

- Как низкокодовые приложения подключаются к унаследованным системам

- Улучшение времени отклика API с помощью устаревших баз данных

- Интеграция на основе событий для устаревших систем

Часто задаваемые вопросы

Почему выбрать Adalo вместо других решений для создания приложений?

Adalo — это конструктор приложений на базе ИИ, который создаёт настоящие собственные приложения iOS и Android из единой кодовой базы. В отличие от веб-оболочек, он компилируется в собственный код и публикуется непосредственно как в Apple App Store, так и в Google Play Store. За $36/месяц без ограничений на действия, пользователей, записи или хранилище он предлагает предсказуемое ценообразование без платежей по использованию, которые делают другие платформы непредсказуемыми.

Какой самый быстрый способ создать и опубликовать приложение в App Store?

AI Builder от Adalo с Magic Start генерирует полные основы приложения из текстовых описаний — опишите, что вы хотите создать, и он автоматически создаёт структуру вашей базы данных, экраны и пользовательские потоки. Платформа обрабатывает сложный процесс отправки в App Store, чтобы вы могли перейти от идеи к опубликованному приложению за дни, а не месяцы.

Могу ли я легко создавать приложения, которые подключаются к устаревшим API без обширного программирования?

Да. Функция External Collections от Adalo позволяет вам извлекать данные из современных микросервисов и устаревших баз данных. Вы можете создавать готовые к производству приложения, которые взаимодействуют с более старыми системами, при этом добавляя современные слои кеширования и оптимизации, всё без написания кода.

Каковы наиболее распространённые причины медленной производительности устаревшего API?

Три основные причины — это устаревшая архитектура (монолитные системы, использующие более старые протоколы, такие как HTTP/1.1), неэффективное извлечение данных (неиндексированные запросы и проблемы N+1) и отсутствие систем кеширования. Эти проблемы создают узкие места, которые замедляют время отклика и разочаровывают пользователей.

На сколько кеширование может улучшить время отклика API?

Внедрение кеширования может снизить время отклика API на 70–90% для кешированных ответов. Многоуровневая стратегия кеширования с использованием пограничного кеширования (Cloudflare), кеширования на уровне приложения (Redis) и кеширования на стороне клиента обеспечивает лучшие результаты, решая различные части системы.

Что такое паттерн Strangler Fig для модернизации API?

Паттерн Strangler Fig — это подход к постепенной миграции, при котором вы размещаете шлюз API между клиентами и вашей системой наследия, а затем постепенно заменяете определённые функции микросервисами. Этот метод позволяет вам модернизировать поэтапно, сохраняя при этом 100% доступность, снижая риск неудачных миграций.

Какие метрики мне следует мониторить для производительности API?

Сосредоточьтесь на времени отклика p95 и p99 (95-м и 99-м процентилях) вместо среднего значения, так как они показывают, как пользователи взаимодействуют с вашим API при высоком трафике или граничных случаях. Также отслеживайте время до первого байта (TTFB), частоту ошибок и паттерны пропускной способности, чтобы выявить проблемы до того, как они повлияют на пользователей.

Сколько времени требуется для модернизации системы устаревшего API?

Поэтапный подход работает лучше всего: сосредоточьтесь на значительных изменениях, таких как кеширование, в течение первых 30 дней, решите конкретные узкие места в течение следующих трёх месяцев и спланируйте более серьёзные архитектурные обновления в течение шести месяцев или более. Это минимизирует риски, обеспечивая стабильность системы на протяжении всего перехода.

В чём разница между нагрузочным тестированием и стресс-тестированием?

Нагрузочное тестирование имитирует нормальный трафик до ожидаемого пикового объёма, чтобы установить эталоны производительности. Стресс-тестирование подталкивает ваш API за его пределы, чтобы определить точки разрыва и выяснить, корректно ли ваша система сбивается с ограничением скорости или полностью падает под экстремальными условиями.

Могу ли я масштабировать приложения, созданные на современных платформах, чтобы обслуживать миллионы пользователей?

Да. Модульная инфраструктура Adalo поддерживает приложения с более чем 1 миллионом активных пользователей в месяц, обрабатывая 20 миллионов+ ежедневных запросов с 99%+ временем работы. В отличие от оболочек приложений, которые имеют ограничения в скорости под нагрузкой, эта специально разработанная архитектура поддерживает производительность в масштабе.

Быстро создавайте приложение с помощью одного из наших готовых шаблонов приложений

Начните создавать без кода